A la demande de plusieurs internautes, nous poursuivons notre couverture de l’intelligence artificielle pour tenter d’expliqier cette thématique, selon différents angles. Cette compréhension est utile même au niveau boursier car Wall Street doit son euphorie actuelle à l’IA avec Nvidia comme porte-étendard qui a été la première entreprise à dépasser les 5.000 milliards de dollars de capitalisation.

Ainsi, en 1943, deux chercheurs américains, le neurophysiologiste, Warren McCulloch et le mathématicien prodige Walter Pitts, publient un article qui passera presque inaperçu : A Logical Calculus of Ideas Immanent in Nervous Activity. Sans le savoir, ils viennent de poser la première pierre de ce qui deviendra l'intelligence artificielle moderne.

Un cerveau réduit à une équation

L'idée des deux chercheurs est radicale. Et belle par sa simplicité.

Leur intuition : le cerveau fonctionne comme un réseau d'unités logiques, chacune recevant des signaux, les additionnant, puis décidant de s'activer ou non selon un seuil.

Ils résument cela par une phrase devenue célèbre : " What the mind is, what the brain is, must be expressible in mathematical terms. ", Warren McCulloch. Pour la première fois, la pensée n'est plus un mystère biologique insondable: c'est un calcul.

Leur "neurone artificiel" – un simple additionneur avec un seuil - est capable de reproduire les portes logiques:

• ET

• OU

• NON

Dit autrement, la logique elle-même peut émerger d'un réseau de neurones. Une révolution conceptuelle.

L'impact inattendu de leur intuition

Ce modèle logique devient la base de plusieurs disciplines comme la cybernétique, qui étudie les systèmes auto-organisés, les premiers réseaux neuronaux, et, beaucoup plus tard, le deep learning qui fait tourner nos assistants vocaux, nos systèmes de recommandation et même les modèles de langage actuels. McCulloch et Pitts ont ouvert une porte que personne ne refermera.

Le grain de sable : un petit problème de logique

Mais au milieu des années 1960, un détail va tout bloquer : le XOR, une simple opération logique qui renvoie 1 uniquement si les deux entrées sont différentes.

Le XOR a un défaut, il n'est pas linéairement séparable. Aucun neurone simple ne peut le modéliser, quelle que soit la combinaison de poids ou de seuil. Le constat fait l'effet d'une douche froide. Certains experts concluent que les réseaux neuronaux n'ont presque aucun avenir. Les financements s'effondrent, la recherche se détourne. On parle même d'un "hiver de l'IA".

La solution, pourtant, était évidente

Il faudra attendre les années 1980 pour redécouvrir ce que McCulloch et Pitts avaient déjà laissé entrevoir : le pouvoir n'est pas dans un neurone, mais dans le réseau. En ajoutant une deuxième couche de neurones, XOR devient trivial. Deux ou trois neurones combinés suffisent pour résoudre ce problème qui avait bloqué la discipline pendant 20 ans.

Cette prise de conscience déclenche une renaissance : si une couche supplémentaire décuple les capacités, alors des dizaines de couches, superposées, pourraient produire une intelligence beaucoup plus riche. C'est le début des réseaux profonds, des apprentissages massifs, et finalement de I'IA moderne.

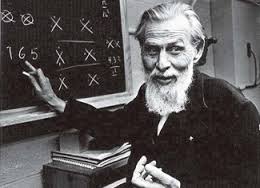

Qui était vraiment Warren McCulloch ?

Derrière cette révolution se cache un personnage singulier. Warren McCulloch n'était pas seulement un scientifique. C'était un penseur hors norme : neurophysiologiste, poète à ses heures, philosophe de l'esprit. Il écrivait sur la logique, les rêves, la conscience et la machine. Il croyait profondément que la pensée humaine pouvait être comprise, non pas en l'opposant à la machine, mais en la reliant à elle. Son travail était en avance de plusieurs décennies.

Pourquoi cela nous concerne aujourd'hui

Chaque fois que nous utilisons une IA - pour traduire un texte, générer une image ou analyser des données, nous utilisons, sans le savoir, l'héritage direct du modèle logique proposé par McCulloch et Pitts. Le voyage qui mène de leur neurone binaire aux modèles actuels compte 80 ans d'idées, d'échecs, de découvertes et d'intuitions visionnaires. Mais tout commence avec une équation simple. Un neurone qui additionne et compare. Un geste conceptuel qui transforme le cerveau en structure calculable. Et cette idée continue aujourd'hui de faire tourner le monde.